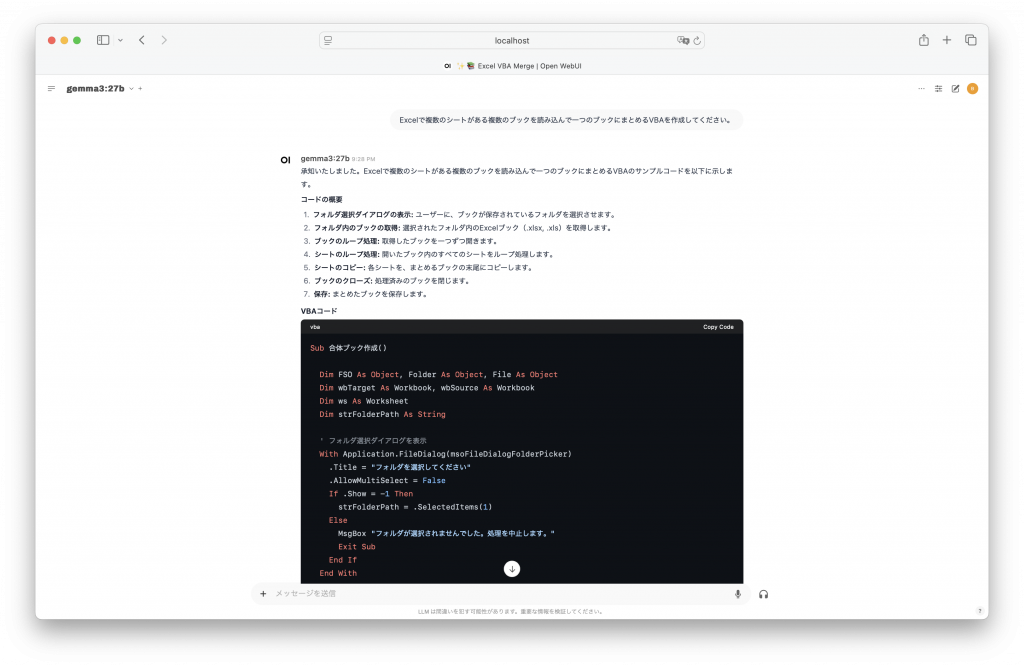

セットアップは、いつもの勉強環境で転がりながらサクッと作成し、動かしてみた。いつもローカルLLMで試している光市の説明は、これも相変わらず変だったけど、試しにVBAの作成を指示してみると、以下のようにそれっぽいVBAをサクッと作ってくれた。(動作は、時間なくて検証とってないので保証できないけど)

プログラムの内容について、かなり詳細に説明してくれてます。(でも、ここで出力を公開するのは問題あるので、画像は一部だけとしておきます)

感想だけど、なんというか、軽いんだよねぇ、これまでのモデルは、ファンが鳴ってたんだけど、これは鳴らないし、体感的に軽いのがわかる。(ちゃんと測定しろよって、自分自身でツッコミ入れておきます🤪)

あとは、いくつかのオンライン無料版のLLMとサラッ😅と、比較しても、こっちの出力の方が正確なんじゃないかと思う程だ。

コンテキストウィンドウが128Kトークンとなるので、学習させなくても、特化した業務とかマニュアルごとプロンプトに読み込ませば、使えそうなレベルなんじゃないかと思うぐらいで、ローカルLLMが実用化するのがすぐそこに見えてきてると感じた。

会社での喫緊のセキュリティ対策を考えると、インターネット接続無しで動くローカルLLMが解だと思うんだけど、どうなんだろう?