随分前からセットアップしているローカルLLM環境だけど、頭でっかちで、全く手を動かしてないので、ちょっと今回はDify + Ollama で Gemma3をいろいろと触ってみた。

落ち着いたら今度インストールやセットアップなどについてまとめてブログに書きたいと思う。おそらく🤔GWだろうなぁ。

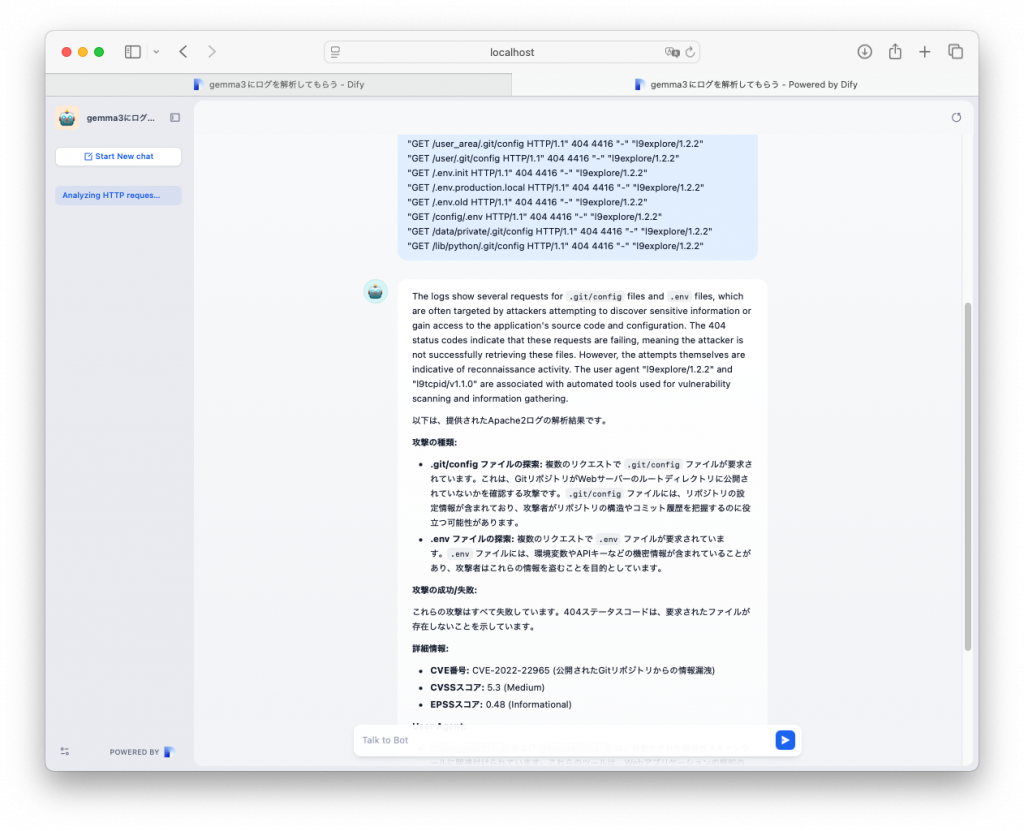

今回やったのは、ChatGPTでやってたApacheのログ解析用のエージェントを作ってみた。思ったより軽く動作した。但し精度はちょっと劣っていてだいぶ改善点はあるけど、先々では、ワークフローにドキュメントの読み込み機能や、外部のサイトを参照する機能とかを追加して完成に近づけたいと思う。

AIエージェントを構築するのには、興味があったんだけど、なかなかキッカケを作れなくて、立ち止まっていたんだけど、このDifyをキッカケに始めてみようと思い立った。

Difyは去年の夏頃に参加した社内セミナーで紹介されていたのがキッカケなんだけど、マシンにセットアップして使えるまでにはしていたんだけど、その後、他のことを優先して、全く使って無かった。

それが、ここ最近になって、Youtubeなどで利用している事例をよく見かけ、ちょっと気になっていた。そして、参考情報も増えているし、Gemma3のようにローカルで動くLLMも進化していることもあり、AIエージェントを簡単に使いこなすんだったら、やっぱりこれなんだろうな🤔と思い今日に至ってます。